Teknologi deepfake suara semakin canggih dan berpotensi disalahgunakan untuk kejahatan, mulai dari penipuan hingga manipulasi informasi. Dengan kecerdasan buatan (AI), suara seseorang bisa ditiru secara realistis, membuat sulit untuk membedakan mana yang asli dan mana yang palsu. Namun, para peneliti kini tengah mengembangkan teknologi baru untuk mendeteksi dan menangkal ancaman ini.

Bagaimana Deepfake Suara Bekerja?

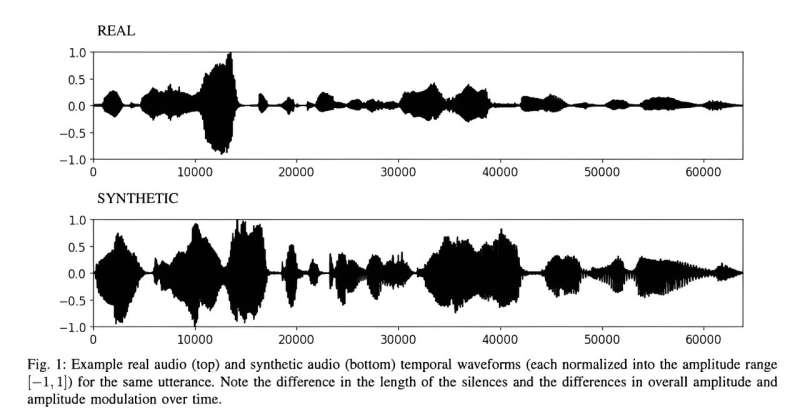

Deepfake suara menggunakan teknik berbasis AI seperti deep learning dan text-to-speech synthesis untuk mereplikasi suara seseorang dengan sangat akurat. Dengan hanya beberapa detik sampel suara asli, sistem ini dapat menghasilkan rekaman audio yang terdengar seolah-olah diucapkan oleh orang tersebut.

Teknologi ini semakin populer dan digunakan untuk berbagai keperluan, termasuk dalam industri hiburan dan asisten virtual. Namun, di tangan yang salah, deepfake suara bisa menjadi alat yang berbahaya, misalnya untuk menyebarkan berita palsu, menipu korban dalam skema keuangan, atau bahkan menyamar sebagai pejabat penting untuk tujuan kriminal.

Ancaman Nyata dari Deepfake Suara

Beberapa kasus penyalahgunaan deepfake suara telah terjadi di berbagai negara:

1. Penipuan Keuangan: Pelaku menggunakan deepfake suara untuk menyamar sebagai CEO perusahaan dan meminta transfer uang dalam jumlah besar.

2. Manipulasi Politik: Suara pemimpin dunia bisa dipalsukan untuk menyebarkan disinformasi dan memicu ketegangan sosial.

3. Pemerasan dan Penipuan Personal: Penjahat dapat menggunakan suara deepfake untuk menipu keluarga atau teman korban, berpura-pura dalam keadaan darurat dan meminta bantuan finansial.

Solusi Teknologi untuk Melawan Deepfake Suara

Para peneliti dan perusahaan teknologi kini tengah mengembangkan berbagai metode untuk mendeteksi dan mengatasi ancaman deepfake suara:

1. AI-Driven Detection: Algoritma berbasis kecerdasan buatan yang mampu menganalisis pola suara untuk membedakan mana yang asli dan mana yang palsu.

2. Watermarking Digital: Teknologi ini menambahkan tanda unik pada rekaman suara asli yang tidak bisa diimitasi oleh deepfake.

3. Verifikasi Suara Berbasis Biometrik: Sistem keamanan yang lebih canggih menggunakan identifikasi suara asli dengan pola vokal unik sebagai lapisan perlindungan tambahan.

4. Pelacakan Metadata Audio: Menganalisis jejak digital dari rekaman suara untuk memastikan keasliannya.

Apa yang Bisa Kita Lakukan?

Sebagai individu, kita juga bisa melakukan langkah-langkah pencegahan terhadap ancaman deepfake suara:

1. Selalu Verifikasi Informasi: Jangan langsung percaya jika menerima panggilan atau rekaman suara yang mencurigakan.

2. Gunakan Sistem Otentikasi Ganda: Dalam urusan keuangan atau komunikasi penting, pastikan ada langkah verifikasi tambahan.

3. Tetap Waspada terhadap Perkembangan Teknologi: Mengenali cara kerja deepfake dapat membantu kita lebih kritis dalam menerima informasi.

Kesimpulan

Deepfake suara adalah ancaman nyata yang terus berkembang seiring dengan kemajuan teknologi AI. Namun, dengan inovasi dalam deteksi dan perlindungan, serta kesadaran publik yang lebih tinggi, kita bisa lebih siap menghadapi risiko ini. Teknologi baru yang sedang dikembangkan dapat menjadi solusi untuk melindungi kita dari penyalahgunaan deepfake suara di masa depan.